Websites im Zeitalter des „Machine Web“

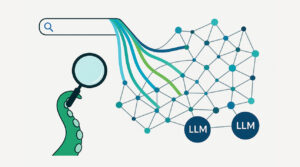

Websites wirken heute fast wie Faxgeräte – ein digitaler Anachronismus. Bis vor kurzem war die Unternehmenswebsite das digitale Schaufenster. Doch mit der Verbreitung von Large‑Language‑Models (LLMs) und KI‑Agenten verändert sich das Informationsverhalten radikal: Nutzer:innen stellen ihre Fragen direkt an generative KI‑Assistenten wie ChatGPT, Gemini, Copilot oder Perplexity. Eine aktuelle Pew‑Studie zeigt, dass bei rund 18 % der Google‑Suchen bereits AI‑Overviews eingeblendet werden und Nutzer anschließend deutlich seltener auf Links klicken. Rund 80 % der Konsumenten nutzen in 40 % ihrer Suchen „Zero‑Click“-Antworten. Der Mensch bekommt die Antwort im Dialog – die Website bleibt unbesucht.

Warum klassische Websites an Bedeutung verlieren

Wechsel vom Browsing zum Conversational Web

Menschen wollen nicht mehr durch überladene Menüs klicken. Sie erwarten natürliche Sprache, sofortige Antworten und Personalisierung. KI‑Systeme liefern diese über Retrieval‑Augmented‑Generation (RAG), semantische Suchindizes und Vector‑Embeddings.

Agentic Web / Machine Web

Im Agentic Web besuchen autonome KI‑Agenten im Auftrag der Nutzer Webseiten, füllen Formulare aus und kaufen ein. Forscher nennen diesen Trend den Machine Web, in dem Inhalte nicht mehr für Menschen, sondern für Maschinen strukturiert werden. Dienste konkurrieren künftig darum, von den Agenten „aufgerufen“ zu werden.

Barrierefreiheitsstärkungsgesetz (BFSG)

Ab dem 28. Juni 2025 müssen Websites strenge Anforderungen an digitale Barrierefreiheit erfüllen. Für viele KMU sind die Umsetzungskosten hoch; gleichzeitig sinkt die Reichweite, weil immer weniger Menschen überhaupt auf die Seite gehen. Die Frage lautet deshalb: Lohnt sich eine klassische Website noch?

Websites im Zeitalter des „Machine Web“

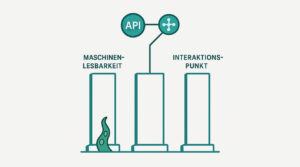

Um in der Agent Attention Economy sichtbar zu bleiben, zählt nicht mehr die „Besucherzahl“ einer Website, sondern wie gut Inhalte von KI‑Systemen gelesen werden. Das bedeutet:

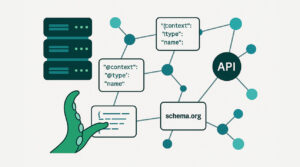

Maschinenlesbare Datenfeeds

Strukturiere dein Angebot über schema.org‑Markup und JSON‑LD, damit KI‑Crawler die Informationen sauber interpretieren können.

API‑first‑Denken

Stelle Informationen via OpenAPI/Swagger zur Verfügung, damit Agenten sie direkt abrufen können.

Präsenz in Ökosystemen

Viele Entscheidungen fallen mittlerweile in LinkedIn‑Profilen, Google‑Maps‑Einträgen, Fachforen oder Marktplätzen. Pflege diese Profile mit strukturierten Daten und klaren Beschreibungen.

Unterstützung offener Protokolle

Google und Anthropic treiben das Model Context Protocol (MCP) voran, Microsoft experimentiert mit NLWeb und A2A‑Protokollen. Sobald verfügbar, sollten Unternehmen diese integrieren, um mit Agenten zu „sprechen“.

Fazit:

Websites verschwinden nicht vollständig, aber sie verlieren die Rolle als Haupteinstiegspunkt. Im Machine Web werden KI‑Agenten deine Inhalte abrufen, analysieren und weitergeben. Für Unternehmen bedeutet das: Fokus weg vom hübschen Frontend, hin zu maschinengerechten Datenstrukturen, kontextbasierter Interaktion und Vertrauen durch verlässliche Quellen. Der ➡️ nächste Teil der Reihe zeigt, wie Suchmaschinenoptimierung in dieser Welt funktioniert.