Warum klicken, wenn ich fragen kann?

Wir erleben den Übergang von einer Such- zu einer Antwort-Kultur. Statt zehn blauer Links liefern KI‑Assistenten wie ChatGPT, Gemini, Copilot oder Perplexity direkt Antworten, vergleichen Optionen und buchen Dienstleistungen. Studien zeigen, dass Nutzer bei einem Viertel der Suchen mit AI‑Übersicht die Sitzung direkt beenden und keine Links mehr anklicken. Ein weiterer Report schätzt, dass heute 80 % der Konsumenten bei 40 % ihrer Suchen „Zero‑Click“-Ergebnisse nutzen. Das Suchfeld verliert an Relevanz; der Dialog wird zur Norm.

Von der Suche zur Antwort

Aggregierte Antworten

KI‑Systeme nutzen RAG und Vector‑Search, um Daten aus unterschiedlichen Quellen zusammenzuführen. Google kündigte mit AI‑Mode einen Suchmodus an, der multistep‑Planung und Follow‑up‑Fragen integriert.

Kontextualisierung

LLMs priorisieren Inhalte anhand von Kontext, Qualität und Aktualität. Unternehmen müssen Quellen, Autorität und Zeitstempel offenlegen.

Personalisiertes Wissen

KI‑Agenten berücksichtigen Vorlieben, Standort und Verlauf. Relevanz entsteht durch präzise, kontextfähige Inhalte – nicht durch Keyword‑Dichte.

Was bedeutet das für Unternehmen?

Wer in Dialogsystemen nicht auftaucht, existiert für viele potenzielle Kund:innen schlicht nicht. Prognosen zufolge könnte der Web‑Traffic in den kommenden Jahren um rund 25 % fallen, weil LLMs Antworten liefern, ohne die Nutzer:innen auf die ursprünglichen Seiten zu schicken. Deshalb müssen Unternehmen ihre Inhalte dialogfähig machen.

Strategien für mehr Sichtbarkeit im KI‑Dialog

Entwicklung dialogfähiger Inhalte

Nutze Q&A‑Formate, FAQ‑Blöcke und klare Definitionen. Ein KI‑Agent kann so direkt eine Antwort extrahieren.

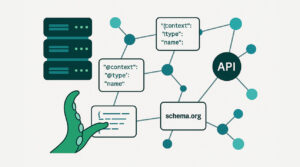

Semantische Datenverknüpfung

Verlinke verwandte Themen, Tagging und Kategorien. Dies erhöht die Kontexttiefe und Sichtbarkeit.

Präsenz in relevanten KI‑Ökosystemen

Pflege Business‑Profile (Google Business, LinkedIn), branchenspezifische Verzeichnisse und offene Wissensgraphen.

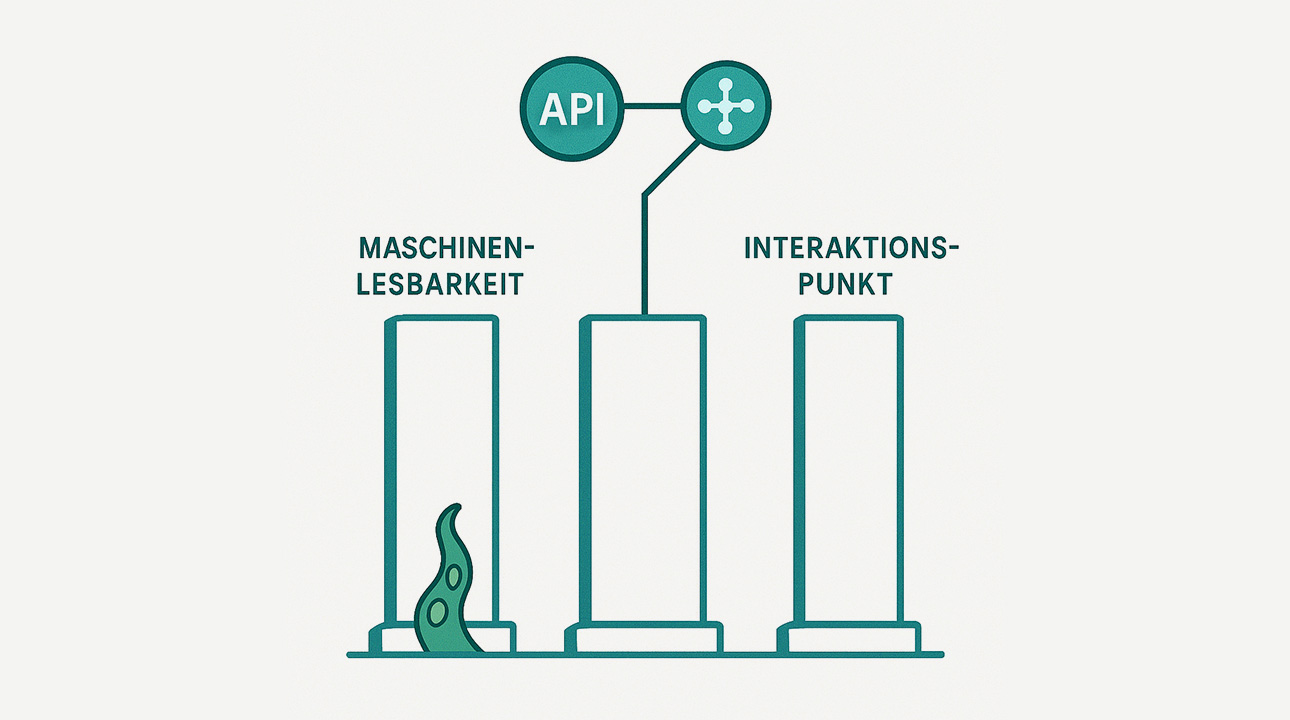

API‑Zugänge bereitstellen

Beispielsweise kann ein Energieanbieter seine Tarife via OpenAPI zugänglich machen; Chatbots empfehlen ihn dann bei energiebezogenen Anfragen.

Monitoring

Analysiere, wie und wann Agenten deine Inhalte abrufen. Tools wie der Adobe LLM Optimizer liefern Einblicke in agentischen Traffic.

Beispiele aus der Praxis

1. Ein SaaS‑Anbieter strukturiert seinen Hilfebereich in Frage‑Antwort‑Blöcke. Dadurch erscheinen seine Support‑Artikel in LLM‑Antworten und senken das Support‑Aufkommen.

2. Ein Energieunternehmen veröffentlicht API‑Endpunkte für Tarife und Leistungen. Agenten integrieren diese Daten in Preisvergleiche und Chatbots.

Fazit

Es gewinnt nicht derjenige, der am besten sucht, sondern derjenige, der am besten verstanden wird. Denke in Konversationen, statt in Seitenstrukturen. Inhalte müssen klar, semantisch und maschinengerecht bereitgestellt werden.

➡️ Im finalen Teil der Serie zeigen wir, wie Sie Ihre digitale Präsenz für die KI‑Zukunft konkret aufbauen können.